本文來自格隆匯專欄:中金研究,作者:李虹潔 袁佳妮 等

ChatGPT自然語言處理模型帶動下游應用百花齊放,AI技術突破對安全產業同樣帶來變革,包括產品檢測效率的提升、賦能安全運營降本增效;同時安全問題隨之出現,對數據、模型的保護,對AIGC的鑑偽等均對安全產品、技術提出了新需求。本篇報吿我們主要梳理了海內外雲廠商、安全廠商如何依託AI技術賦能安全產品,以及對數據、模型安全保護的思考。

摘要

大模型作為新型數字基礎設施,安全保駕護航。海內外雲廠商對於雲基礎設施從IDC機房、硬件服務器、虛擬機,到雲上應用、數據都進行了全方位的深度安全保護。推演至大模型,作為與雲同等的新型數字基礎設施,同樣需要安全防護。從模型訓練所需的數據、模型本身、AIGC的鑑偽,對安全產品、技術、形態、應用場景、商業模式都提出新的需求,也為安全行業帶來新增量市場。同時,AI的突破使得攻擊手段更為多樣複雜,安全廠商也需要提升創新水平、攻防能力,來面對AI新紀元下的安全挑戰。

大模型及AIGC內容監管,海內外廠商提出新策略。OpenAI推出ChatGPT後,對安全的投入也持續加強,包括招募專家進行對抗性測試、對預訓練數據篩選過濾、微調模型優化輸出結果、持續監控模型濫用等,從策略層面保障模型安全問題。國內從政策層面對AIGC進行相應監管,對模型的安全評估審查、生成式內容標識、用户數據保護等提出了多項要求。國內廠商也對AIGC內容監管、鑑偽佈局相應產品。我們認為,隨着大模型的落地、AIGC的應用豐富,生成式內容監管的要求和產品需求有望提升。

依託AI技術,提升安全產品檢測能力與運營效率。微軟將安全與GPT融合發佈Security Copilot,依託強大的威脅情報能力通過關聯內容發現潛在攻擊信號,加強安全檢測能力,同時以自然語言形式交互,提升安全運營人員體驗的同時降本增效;其他海外安全頭部廠商將AI能力嵌入核心產品,例如Palo Alto Networks、Fortinet基於AI賦能防火牆,CrowdStrike、Zscaler以AI加強雲安全,並實現以AI能力作為單獨組件或集成至平台收費。國內廠商如深信服基於大模型算法+海量安全數據+威脅情報+安全知識訓練出安全GPT模型,對標Security Copilot,公司預計下半年將安全GPT接入全線安全產品,提升整體競爭力。

風險

政策落地不及預期,技術發展不及預期,下游需求不及預期。

AI安全的兩大維度:

AI賦能安全,安全保護模型

OpenAI推出的ChatGPT自然語言處理模型興起,切換至安全視角,AI的發展是生產力的變革,賦能安全產品和服務提質增效;同時,AI引發的安全問題,需要廠商從數據、模型等維度出發,依託相應的安全技術為AI保駕護航。

本篇報吿我們梳理了中美主要雲及安全廠商如何依託AI提升安全能力、降本增效。同時,我們看到美國雲廠商在保護雲基礎設施時,基於各類安全手段提升防護效果。延伸至大模型領域,大模型作為與雲等同的數字基礎設施,為各類業務提升效率的同時,也同樣需要安全產品、安全技術對其進行保護。同時,由於大模型在不斷迭代更新,相應的攻擊手段在變化,對安全防護技術也提出了更高的要求,產品力演進的過程中也將推動產業格局向優秀公司集中。

AI賦能安全產品,助力安全廠商提質增效

AI技術依託強大的算法和模型支撐,可以提升複雜的安全數據分析能力、自適應防護能力及輔助安全運維的工作,目前在態勢感知、威脅情報、安全運維、異常檢測、流量識別等方面應用。例如,深度神經網絡可以無需手動特徵提取,直接訓練原始數據,確定數據間的非線性相關性,藉助泛化能力完成對新文件類型或者未知攻擊的檢測,在防止APT攻擊方面進展明顯,提升威脅檢測的效率和準確性。我們認為,安全知識複雜深奧,通常需要專業的安全人員對攻擊進行研判,AI作為生產力提升的重要工具,可以助力安全人員提升工作效率,降低運營成本和門檻。

AI賦能安全產品的案例

► 惡意流量識別

Webshell作為命令執行環境,通常以PHP、JSP等網頁文件形式呈現。攻擊者可以利用網站漏洞,把Webshell後門文件傳輸到服務器,由於此時後門文件和正常網頁文件混合在一起,攻擊者可以通過訪問瀏覽器控制和竊取網站數據。傳統對於惡意流量識別的方法是對報文中的特殊字符串匹配。但攻擊者仍可以混淆代碼繞過匹配,並且由於Webshell種類多,需要較高的人工分析成本。

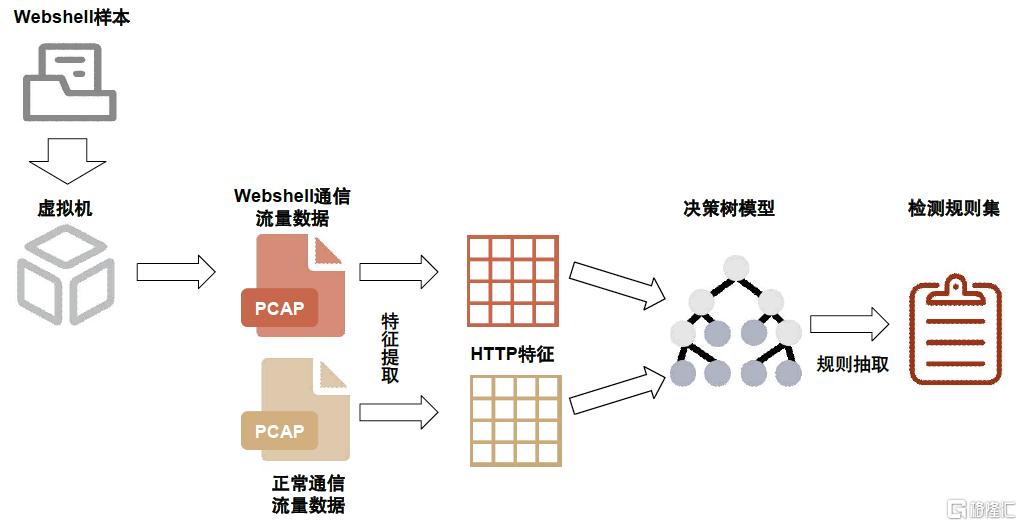

為優化惡意識別問題,安全廠商依託AI算法提升效率。例如可以基於決策樹算法的智能檢測及規則自動化提取防範,自動分析Webshell的樣本和採集通信流量,通過報文特徵構建決策樹,提升檢測的準確性,同時可以通過模型實現自動提取檢測。

圖表1:Webshell智能檢測與規則自動化提取技術

資料來源:《人工智能賦能安全應用案例集(AI in Security)》(GSMA,2021年2月22日),中金公司研究部

► 智能安全運維

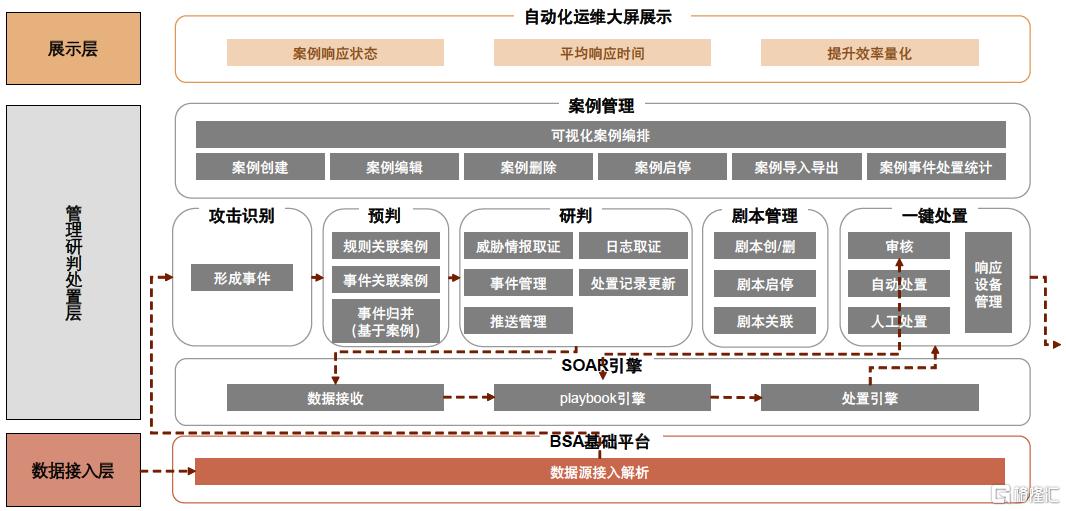

傳統的安全運維方式存在吿警過多、處置時間長、需要有經驗的人員人工研判等問題。在安全運維領域,AI可以賦能事件分析研判、可視化編排等技術,和專家經驗有機結合,提升威脅的判斷準確率、運營效能。

圖表2:綠盟科技智能安全運維AIOps

資料來源:《人工智能賦能安全應用案例集(AI in Security)》(GSMA,2021年2月22日),中金公司研究部

AI對安全廠商的加持:核心圍繞降本、增效

提質增效:當前AI賦能安全產品的主要作用體現為攻擊響應、威脅檢測和漏洞挖掘,核心是效率的提升和智能化的應用,可以減輕人工成本和提升防護能力。在安全專業人員缺口持續存在的環境之下,AI賦能安全緩解了人員缺口問題,助力安全廠商降低人力成本、提質增效。

安全模型演進:長期視角,為提升研發效率,我們認為,安全廠商有望訓練符合自身需求的安全模型。一般會基於情報分析、報警日誌分析等多個細分場景小模型出發,訓練較為通用的安全大模型,大模型和小模型之間相互迭代優化,用小模型迭代和打標籤提升大模型的性能,或者從稍微大的場景出發建立中等模型,然後遷移到小型場景領域;由於安全模型屬於垂直細分行業的模型,模型的壁壘較高,其訓練數據來自安全廠商多年積累的、有價值的安全數據資產。安全廠商有望基於安全模型,提供Model-as-a-Service,變現的同時優化商業模式。

數據和模型安全是AI持續發展的基礎

ChatGpt帶來生產力的變革,同時也催生出相應的安全問題。2023年3月20日,ChatGPT發生數據泄露事故;2023年3月31日意大利禁用ChatGPT並提出其缺乏收集及存儲個人信息的法律依據等多項指控。

技術維度,藉助機器學習,殭屍攻擊者可以重複進行攻擊任務並自我更新。作為大語言模型的GPT-4能夠快速生成釣魚郵件、編寫惡意軟件與代碼等,降低網絡安全攻擊的門檻,大模型本身也是重點的受攻擊對象,需要安全產品保障系統正常運轉,帶來新的安全需求空間。因此,我們認為數據、模型的安全使用成為了AI持續發展的基礎。

► 數據維度:保護原始數據防泄漏

作為AI發展的三大要素之一,數據是AI模型訓練、優化的基礎。數據是AI重要的輸入,但對於輸入數據的安全性也需要保護。我們認為,首先需要對數據的使用權、所有權、運營權進行確權,使用數據時仍需對於敏感數據進行隱私保護,實現在充分挖掘數據使用價值的同時保障數據安全。因此,對數據安全的技術發展、應用場景都提出更高要求。

► 模型維度:保護大模型基礎設施

大模型作為與雲等同的數字基礎設施,需要安全保駕護航。國內外雲廠商對安全重視的意識成熟,從對IDC的邊界安全保護、雲上虛擬機防護、抗DDoS、到對雲上數據保護,安全為雲上業務、數據流轉奠定基石。延伸至大模型,對安全的投入需要進一步加強,在和雲同等的邊界、業務、數據保護以外,還需要對AI生成的文字、圖片等進行鑑偽。我們認為,大模型更新迭代,對安全的要求持續提升,相較於傳統安全產品,AI安全產品從技術、應用場景都有差異,對安全廠商創新能力也提出更高要求。

AI鑑偽技術應運而生。AI生成式技術快速發展,隨着AI生成的文字、圖片增加,我們需要準確判斷哪些樣本是AI生成,從而避免違法事件的發生。以基於生成對抗網絡的機器人深偽(Deep Fake)為例,其利用機器學習的現有數據採樣生成虛假的文本、圖像、視頻,達到欺騙效果。對於司法鑑定、公安等部門,需要鑑真產品檢測深偽技術的篡改,防範由生成式AI濫用所引發的新型網絡詐騙犯罪。

從OpenAI的模型保護看AI安全

OpenAI模型安全的關注焦點:輸出正確、保障用户隱私

GPT-4所面臨的安全挑戰主要可以歸納為非真實內容輸出、有害內容輸出、用户隱私及數據安全問題。根據GPT-4技術報吿,當前模型可能生成無意義或不真實的內容,導致信息質量及準確度下降。此外,模型雖然從獲得許可與公開可用的數據源中學習,但可能還是會涉及用户個人數據。同時,在掌握大規模樣本數據並持續承擔數據處理任務的情況下,模型錯誤易導致數據泄露問題。

OpenAI如何保護GPT-4?

整體規劃:OpenAI採取持續迭代的方式進行模型部署,在部署的前、中、後過程中均進行嚴格的審查。部署前,利用安全評估和對抗性測試進行風險分析;部署時,從小型用户羣體開始測試並深入研究試點結果;部署後,審查使用案例,設置token配額及速率限制等。

具體措施:OpenAI採取多項措施應對安全挑戰,包括招募專家進行對抗性測試、對預訓練數據進行篩選和過濾、微調模型拒絕部分不當請求、深入分析潛在的部署風險、提供詳細的用户文檔以供參考、構建工具篩選有害惡意的模型輸出、對照已頒佈條款和政策審查使用案例、持續監控模型濫用跡象、研究模型影響等。以降低模型侵犯個人隱私權的風險為例,OpenAI通過微調模型可拒絕私人信息的請求,在可行的情況下從訓練數據集中刪除個人信息,創建自動模型評估、監控和響應用户試圖生成信息的請求,並在條款和政策中限制使用。同時,Open AI保證不會使用數據來銷售服務、做廣吿或建立檔案。

► 招募外部專家開展對抗性測試:自2022年8月,OpenAI通過多位AI生成一致性、網絡安全、國際安全等領域的外部專家對GPT-4進行對抗性測試,即採取攻擊者的思維方式與攻擊方法在模型中尋找缺陷和漏洞,從而進一步完善模型。

► 篩選和過濾預訓練數據:預訓練階段,OpenAI通過內部分類器等識別並標記高概率含有不當內容的文檔,通過預訓練集中刪除相關文檔,實現對GPT-4的數據集的篩選。

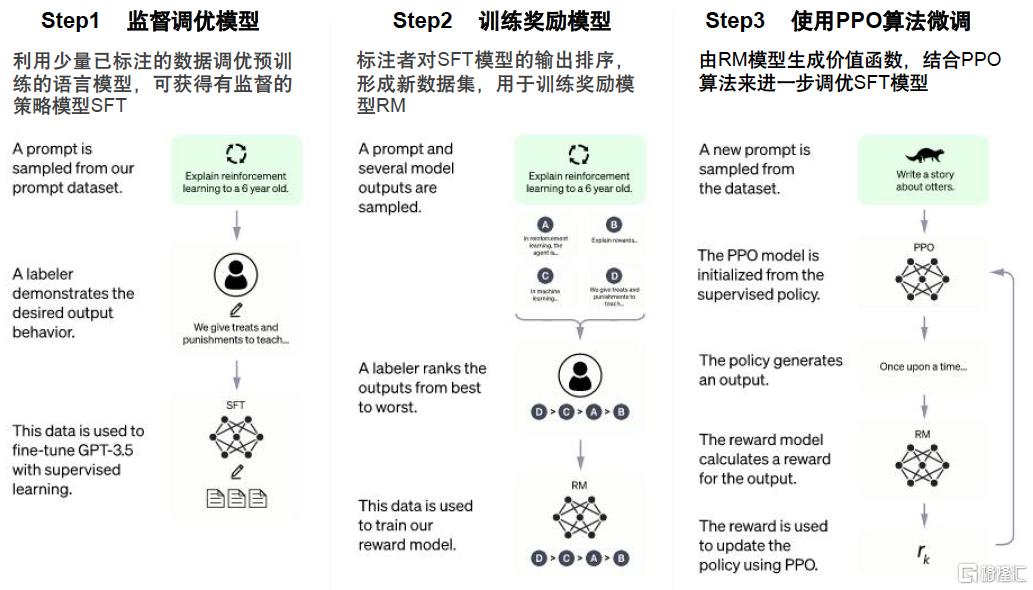

► 微調模型優化輸出結果:OpenAI採用RLHF(人類反饋強化學習)的方法訓練模型。為解決RLHF微調後模型中依然存在的風險輸入、產生有害且有誤內容的問題,OpenAI在GPT-4中添加了安全相關的RLHF訓練prompt,同時提出基於安全規則的獎勵模型(RBRM)。在向RBRM輸入prompt、GPT-4的輸出以及人工設置的安全規則後,RBRM對輸出內容排序,獎勵GPT-4拒絕生成有害請求或者不拒絕生成安全請求的行為。

► 持續監控模型濫用:OpenAI不斷從實踐中優化和改進,通過服務和API將模型集成至產品中,持續監控濫用行為並推出解決措施。

圖表3:RLHF運作機制

資料來源:OpenAI官網,中金公司研究部

覆盤海外:AI內置於安全,商業化已落地

Microsoft Security Copilot:安全產品與LLM模型的融合

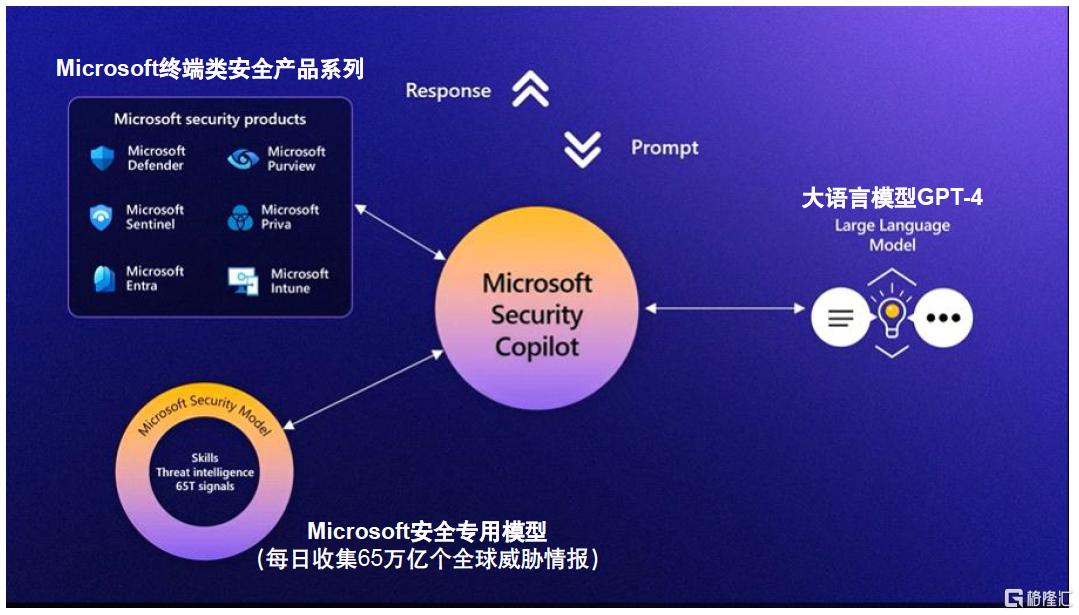

微軟基於GPT-4發佈首個生成式安全產品Security Copilot。2023年3月28日,Microsoft發佈Security Copilot,核心是OpenAI的GPT-4與Microsoft安全專用模型的融合。形式上,Security Copilot接受自然語言輸入,首次以對話形式提供安全服務,界面友好、交互方式新穎。

功能維度:事前評估階段,Security Copilot具備強大的分析能力,能夠挖掘出潛在攻擊信號;同時,核心壁壘在於可以依託Microsoft每日收集到的65萬億個全球威脅情報,通過關聯內容發現威脅,給出推薦方案,實現對安全威脅的提前發現和處置;網絡攻擊發生時,Security Copilot能夠及時識別並提出補救方式,實現對安全事件的高效快速響應;呈現結果時,可以在幾分鐘內完成總結,針對安全攻擊事件、威脅等生成報吿。此外,Security Copilot能夠與Microsoft終端類安全產品集成,包括Microsoft Defender、Microsoft Sentinel等,公司表示有望進一步擴展至第三方產品生態體系中。

Security Copilot的價值:Security Copilot屬於AI賦能安全的典型產品。Security Copilot在提升效率和智能化程度之外,獨特之處在於能夠以對話形式回答安全問題,高效輔助安全專家;作為閉環學習系統,Security Copilot還可以根據用户反饋持續學習,調整響應內容,不斷迭代和完善AI安全產品。

圖表4:Microsoft Security Copilot

資料來源:Microsoft Secure大會(北美時間2023年3月28日),中金公司研究部

海外雲及安全廠商佈局:AI賦能安全產品,初步實現商業化

借鑑海外廠商在AI安全方面的佈局,通過內生外延豐富安全能力,增強對相關數據、應用安全的保護,並與核心產品融合,在提質增效的同時,實現商業價值。

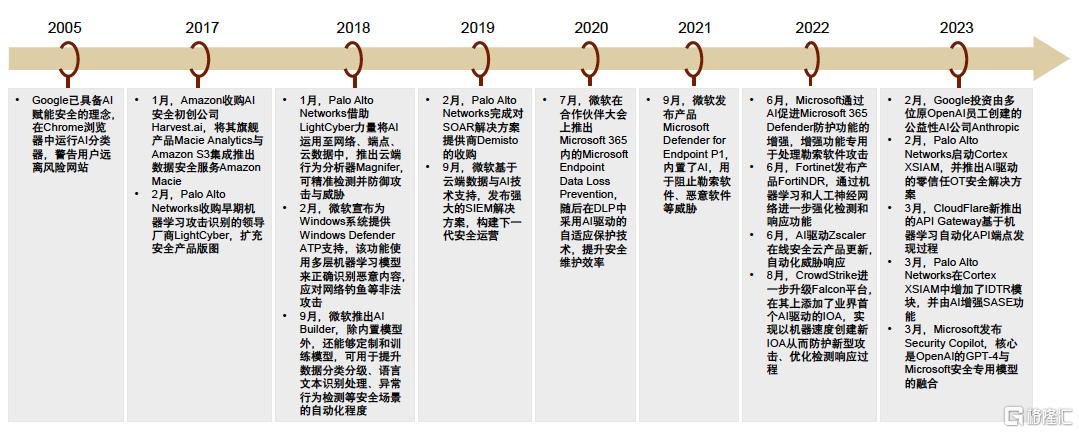

圖表5:海外雲及安全廠商重要AI安全產品與收併購梳理

資料來源:各公司官網,中金公司研究部

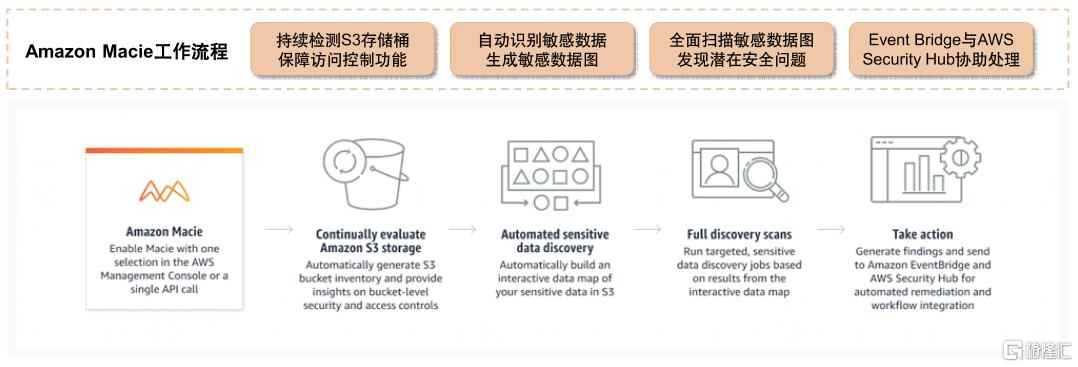

Amazon

AI技術助推數據安全服務,分類保護AWS敏感數據。2017年,Amazon收購AI安全初創公司Harvest.ai,Harvest.ai旗艦產品Macie Analytics藉助AI技術對用户數據使用情況進行實時監測,分析其中可疑行為模式,防止用户數據泄露。隨後,Amazon基於Macie Analytics推出安全服務Amazon Macie,通過機器學習對用户存儲在AWS中的敏感數據進行自動識別、分類與保護。目前Amazon Macie可支持Amazon S3存儲服務。Amazon Macie服務也可與AWS安全中心集成,聚合處理來自AWS安全服務的潛在警報,提升安全性能。除Amazon Macie外,Amazon基於AI技術推出威脅檢測服務Amazon GuardDuty,持續監測未經授權的行為與惡意活動,維護數據存儲安全。檢測到潛在惡意攻擊時,Amazon GuardDuty生成對應安全問題清單,提供全面數據保護服務。

圖表6:Amazon Macie工作原理

資料來源:Amazon官網,中金公司研究部

AWS建立五層安全防護模型,強調自動化防護機制。AWS建立多層安全防護機制,主要囊括威脅檢測與事件響應、身份認證與訪問控制、網絡與基礎設施安全、數據保護與隱私、風險管控與合規五大方面。安全防護模型強調通過雲上統一API與集中事件管理建立自動化防護機制,提升安全監測效率。

1) 威脅檢測與事件響應方面,Amazon GuardDuty集成機器學習能力,實現對威脅進行及時、精準、高效的檢測,Amazon Security Hub則對安全合規風險進行自動監測響應,並及時啟動合規性檢查,提供對應技術修復方案;

2) 身份認證與訪問控制方面,Amazon提供高效的集中管理身份認證服務,建立嚴格的權限機制與數據邊界,維護數據安全;

3)在網絡與基礎設施安全方面,AWS藉助Amazon Shield Advanced及Amazon WAF進行穩定的DDoS攻擊防禦,為用户提供持續的網絡訪問安全保障;

4)在數據保護與隱私方面,Amazon集成雲端各項服務,實現數據存儲、傳輸及使用的全流程加密;

5)在風險管控與合規方面,AWS通過雲計算專家、雲安全公吿板、雲安全服務等工具實現自動化管理評估,保證用户的安全合規性。

AWS對於雲基礎設施進行全方位安全防護,與雲基礎設施等同的大模型,也需要安全產品、技術為其保駕護航。我們認為,對雲基礎設施的保護,從邊界、虛擬機到雲上數據的保護,大模型也同樣需要從邊界到對數據的全方位保護,並且對安全技術提出更高的要求。

AI內嵌於各類產品,提升安全防護效率。Google依託AI技術對多項產品進行異常與惡意行為檢測,提出自動化安全建議並提升安全專家工作效率。在Gmail中,AI系統協助過濾惡意軟件與網絡欺詐郵件;在Chrome瀏覽器中,AI分類器為用户提供風險網站的區分及警吿。此外,Google推出的Chronicle Security Operations和Mandiant Automated Defense藉助機器學習對關鍵警報進行識別,為用户提供風險預警。Breach Analytics for Chronicle通過以機器學習為基礎的評分算法協助團隊匹配IOC,進一步尋找仍存在的安全問題。reCAPTCHA Enterprise和Web Risk通過無監督學習模型對各類虛假或被勒索的賬户進行檢測,降低數據泄露風險。Cloud Armor Adaptive Protection和Mandiant Automated Defense藉助機器學習模型檢測並阻止潛在DDoS攻擊。

CrowdStrike

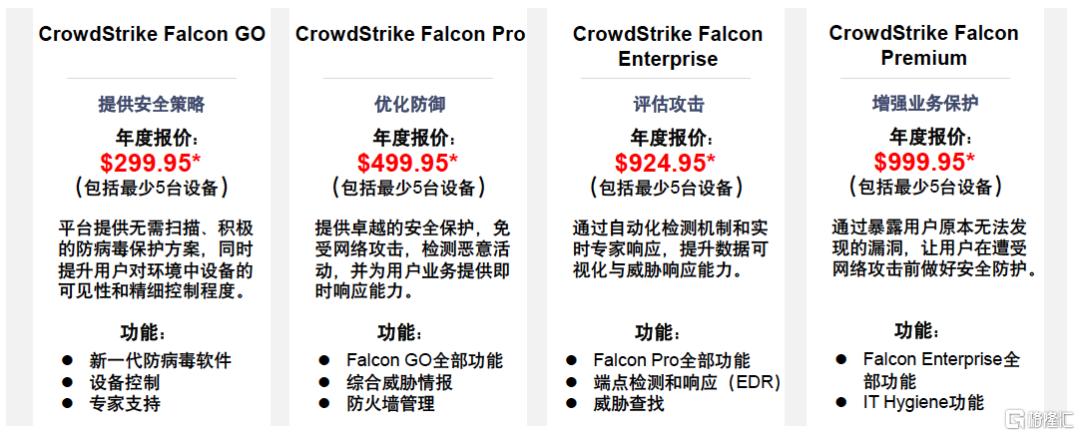

雲原生安全平台CrowdStrike Falcon運用AI防護威脅。公司拳頭產品雲原生端點保護平台Falcon Platform基於AI技術整合威脅情報並進行分析,為用户提供阻止網絡入侵攻擊的有效解決方案。Falcon平台提供端點安全、威脅情報、雲端安全等多個模塊,每一個模塊均通過單一端點代理程序的雲端管控台運行,用户可根據自身需求選擇對應模組功能。Falcon平台主要有兩大優勢,即威脅圖像(Threat Graph)與輕量級代理(Lightweight Agent)。一方面,作為支持Falcon終端保護平台運行的關鍵功能,Threat Graph在公司安全雲架構與大量數據儲備的基礎上引入AI驅動的分析機制,將實時分析結果情境化,持續檢測並預防潛在威脅,提升安全團隊響應效率。另一方面,智能的輕量級代理不僅可以記錄端點活動信息,通過AI技術識別和預防未知網絡攻擊,阻止惡意軟件,還能降低用户終端消耗,改善安全防護機制。單一的輕量級代理與統一管理的雲平台提升了用户使用體驗的便利性,也體現了Falcon平台的獨特優勢。

圖表7:CrowdStrike Falcon平台集成部分AI能力,提升定價權

資料來源:CrowdStrike官網、中金公司研究部

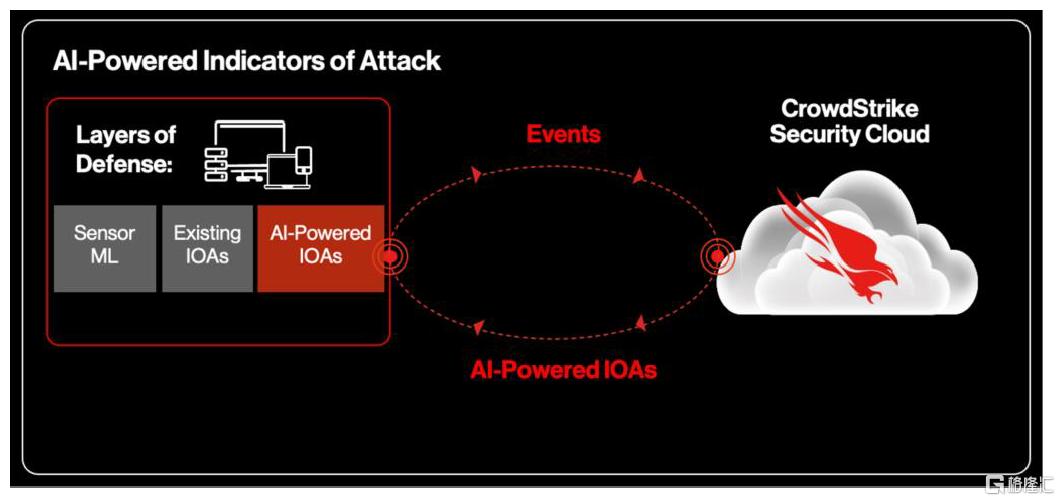

AI技術賦能攻擊指標IOA,提升預測和阻止攻擊的效率。IOA是提示潛在網絡攻擊的事件序列,該指標專注於檢測攻擊者的意圖和所採取的技術,因此IOA可以幫助分析團隊在系統被破壞前發現並中止攻擊行為。通過跟蹤IOA,分析人員能從事件發生順序中快速推斷出攻擊者的行為動機,由關鍵攻擊點確定攻擊的全貌,並藉助行為分析與建模完成預測。相對於專注識別惡意行為或工具的傳統入侵指標IOC,IOA化被動、靜態的安全防護機制為主動、動態的機制;且IOA不侷限於已明確是惡意攻擊的行為,而是關注一切有潛在威脅的行為,更能適應日益複雜的網絡攻擊威脅。基於安全雲數據訓練的雲原生AI模型,公司在業界首創由AI驅動的IOA。為加強網絡安全防禦,AI驅動的IOA藉助機器學習模型與實時威脅情報分析正在發生的事件,並向傳感器動態發佈IOA,傳感器通過關聯AI驅動的IOA和本地數據判斷行為是否惡意。AI賦能的IOA、現有的IOA、傳感器的機器學習模型均集成在雲原生平台Falcon中。

AI賦能後,IOA的功能優化體現在:

► 加快檢測新威脅的速度:AI模型持續學習驅動的IOA指標可協助團隊更快地分析情報、發現新網絡威脅。

► 提升預防措施的自動化程度:雲原生AI模型與Crowd Strike Falcon傳感器共享實時IOA,不受惡意軟件的種類限制,直接阻止攻擊。

► 減少漏報誤報,提高生產力:通過集成AI驅動的IOA與專家分析意見,攻擊信息漏報誤報的數量顯著減少,安全分析團隊的工作效率明顯提升;大量自動化監測威脅的數據及相關知識也有助於提升團隊生產力。

圖表8:AI賦能IOA的運行機制

資料來源:CrowdStrike官網,中金公司研究部

Palo Alto Networks

推出業界首個AIOps for NGFWs,革新防火牆運營。當前傳統防火牆產品在安全態勢分析、主動防禦以及運營層面存在不足,例如運營層面防火牆過載問題,可能引發業務中斷。公司將AI能力沉澱至防火牆產品,推出AIOps for NGFWs模塊應對挑戰。1)態勢分析層面,AIOps for NGFWs基於行業標準、安全情境及防火牆收集的遙測數據,提供最佳配置建議,加強安全態勢;2)防火牆運營層面,AIOps提前七天分析、預測防火牆運行狀況,降低業務中斷的可能性;在運營過程中,AIOps實現了應用、威脅、網絡等信息的一站式檢測,篩選出隱患較大的警報,並且明確優先級,節省時間。

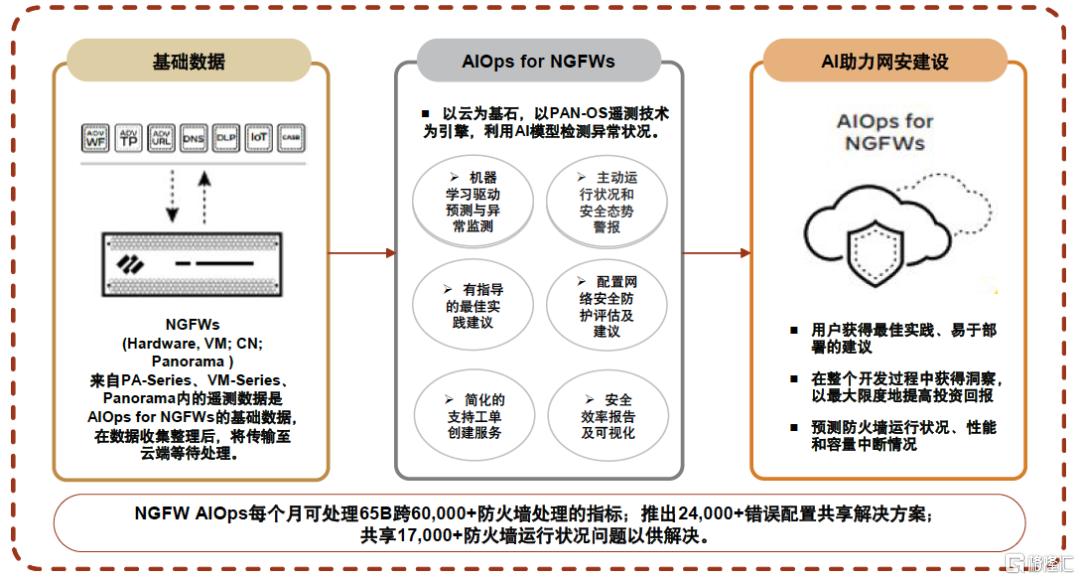

► AIOps for NGFWs的工作機制

AIOps for NGFWs以云為基石,以PAN-OS遙測技術為引擎,主要依託來自PA-Series、VM-Series、Panorama內的遙測數據。在遙測數據傳輸至雲端後,利用訓練好的AI模型檢測異常情況並且提供操作建議。

圖表9:AIOps for NGFWs的工作機制

資料來源:Palo Alto Networks官網,中金公司研究部

► AIOps for NGFWs的商業價值:助力客單價提升

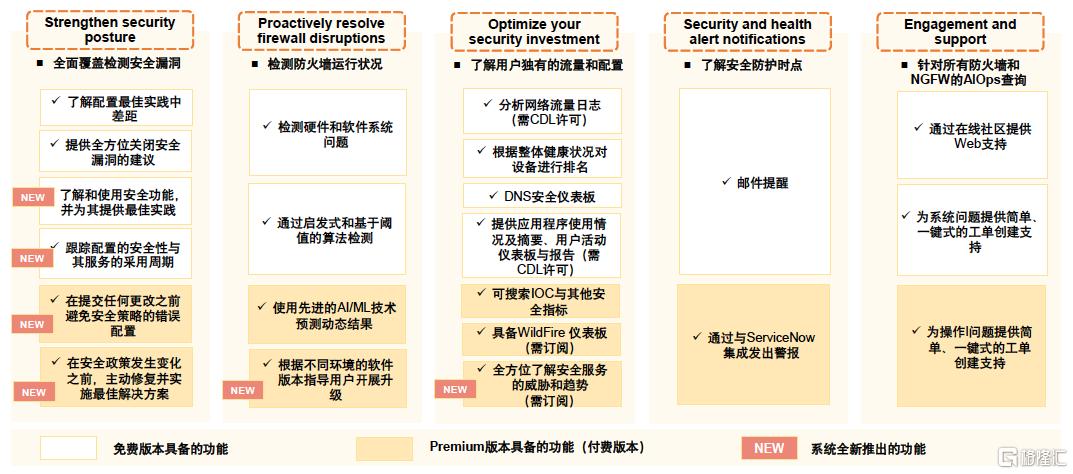

目前AIOps for NGFWs分為免費版和付費版:免費版包含部分基礎功能,在應用中心內直接激活即可;付費版增加了業務中斷預測、威脅檢測等功能,用户需要購買相關訂閲服務。

圖表10:NGFW AIOps免費和付費高級版可用功能

資料來源:Palo Alto Networks官網,中金公司研究部

AI驅動SOC的檢測和響應流程。SOC主要負責處理防火牆、身份認證等基礎設施產生的各類安全吿警日誌,並且持續檢測威脅、提供自動響應攻擊。公司的自動化SOC平台Cortex,涵蓋的產品包括Cortex XDR、Cortex XSOAR、Xpanse、XSIAM:(1)Cortex XDR:主要功能為檢測攻擊,方法為整合流量數據和惡意行為,防火牆等終端數據接入後,XDR可以自動完成關聯分析。AI模型獲取數據後,將行為與預期的基準水平做比較,確認異常後發出警報。(2)Cortex SOAR:主要功能為響應,方法為在接收檢測源的信息後,自動處理警報,執行預設的流程。AI模型能夠從歷史事件中學習,並結合歷史操作記錄提供建議。(3)Cortex XSIAM:當終端客户同時購買多家供應商提供的安全產品時,數據收集與關聯成為新難題。XSIAM利用AI交叉關聯數據,在客户側運行標準化的數據湖,大幅縮減響應時間,快速阻止威脅。

Fortinet

公司AI產品佈局豐富,已形成可聯動的產品體系。FortiGuard Labs是公司產品融入AI技術的起點,負責識別惡意活動,生成威脅情報。在威脅情報支撐下,AI進一步滲透至FortiGate、FortiSandbox、FortiMail、FortiWeb、FortiEDR、FortiClient等產品,面向不同場景提供防護。

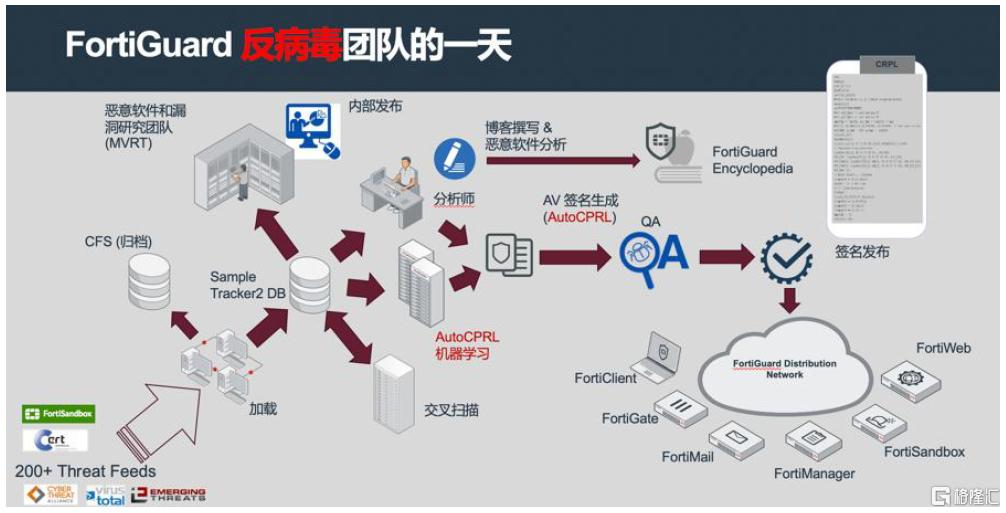

AI賦能FortiGuard Labs,將實時威脅情報分發至終端產品。隨着網絡攻擊速度、規模提升,客户需要快速獲取威脅情報與安全防護方案。公司FortiGuard Labs主要負責網絡安全威脅問題的發現和解決。運用AI技術,FortiGuard防禦的效率和準確性有所提高。在提供實時威脅情報方面,FortiGuard Labs採用SEDS人工智能系統分析安全事件,將威脅情報通過全球分發網絡推送給所有被訂閲的Fortinet產品中。其中,SEDS系統通過多層神經網絡,每日訓練2000萬+文件,生成數以十億計的特徵,同時進行持續學習與特徵強化,提高準確度。在威脅檢測威脅、警報發送方面,FortiGuard Labs以MITRE ATT&CK分析框架為基礎,由AI加速了威脅事件的警報、檢測、分析、補救過程。

► 以FortiGuard中反病毒研究小組為例:數百個威脅信息流匯聚的海量數據加載、歸檔後,統一存儲在數據庫之中。可疑樣本先完成交叉掃描,然後運用AI技術檢測惡意行為,複雜樣本由專家進行分析。如果被分析的樣本確認為高風險,分析師從中提取出IOC。根據IOC生成的簽名自動化生成後發佈,為FortiMail、FortiGate等系列產品提供威脅情報。

圖表11:FortiGuard工作流程

資料來源:Fortinet公眾號,中金公司研究部

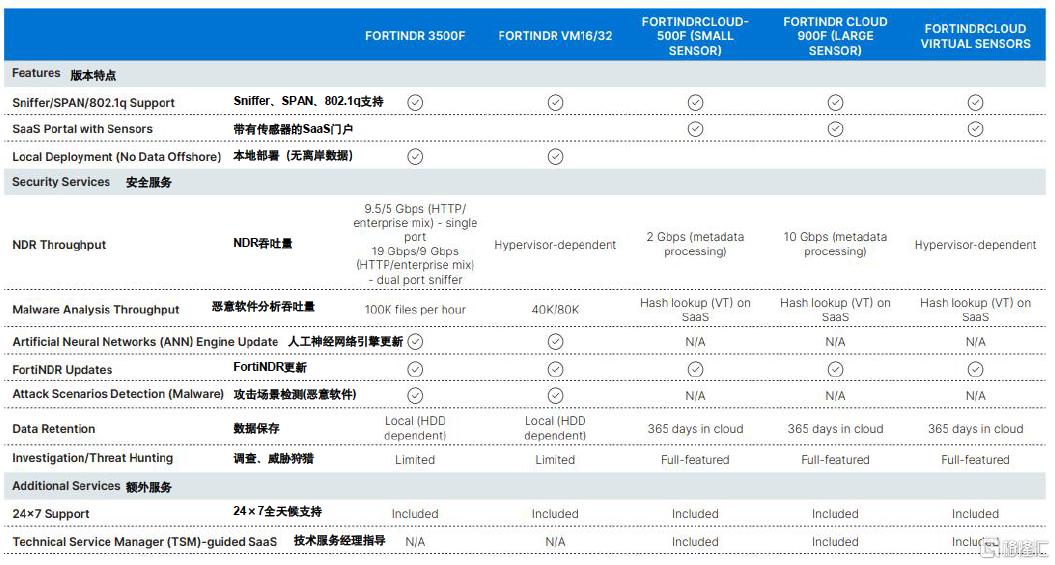

FortiNDR可實現私有網絡檢測與響應,是公司AI應用最新成果。NDR在網絡流量分析NTA技術的基礎上加入流量響應能力,是兼具威脅檢測、響應功能的產品。當前部分客户需要建立面向自身網絡、應用、計算資源的私有威脅情報檢測中心。公司2022年推出FortiNDR,能夠部署在客户私有網絡中,檢測惡意軟件,分析攻擊原因,實時響應威脅。AI技術融入其中進行賦能:(1)通過識別和監測網絡流量,快速檢測出網絡威脅;(2)檢測出攻擊後自動採取相應措施阻止,減小損失;(3)自動化事件數據收集、事件數據分析、基準數據對照過程,快速完成安全事件影響評估。

圖表12:FortiNDR可提供多種訂閲版本

資料來源:Fortinet官網,中金公司研究部

CloudFlare

AI自動化優化API端點的發現與監測。公司推出的API Gateway可基於AI技術自動化端點的管理和監測。通過API Gateway,客户可開展API發現、管理分析與分層防禦,確保API安全。API Gateway中的一系列安全防護組合可以協助預防API的部分風險,例如數據過度暴露、安全配置錯誤、缺乏資源與速率限制等問題都將得到有效解決。

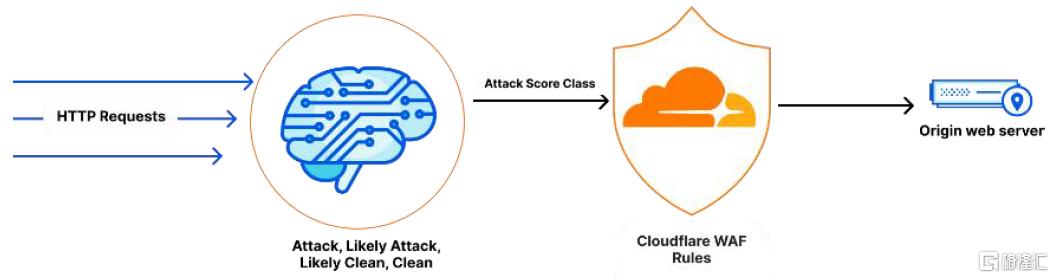

AI模型助力應用程序防火牆建設。公司始終致力於在識別異常、商業智能等方面運用AI技術。由於Web應用程序容易出現信息泄露,WAF的建設較為重要。2022年12月,公司為企業用户推出WAF Attack Score Lite和Security Analytics,主要提供檢測攻擊、緩解攻擊、提升流量整體可視性等服務。公司為WAF的託管規則創建了補充功能,通過機器學習技術協助檢測未知攻擊,及時維護數據信息安全。公司採用有監督的機器學習模型,通過WAF託管規則生成包含多次請求的訓練,持續優化訓練模式,緩解不同類型攻擊,打造更安全的互聯網平台。

圖表13:早期檢測+強大的緩解措施=更安全的互聯網

資料來源:CloudFlare官網,中金公司研究部

Okta

AI應用於自適應身份驗證產品,提升檢測與響應能力。基於Okta Identity Cloud,公司自適應多重身份認證為雲、數據、Web應用程序等提供身份驗證和身份保護能力。風險身份驗證是公司自適應多因素身份認證產品的功能之一,是公司應用AI技術的代表。依託機器學習,公司將輸入的設備、位置、IP地址等數據轉換成上下文行為配置文件,集合外部風險信號補充相關背景信息,為不同風險級別匹配對應訪問政策,從而使風險身份認證自動檢測、響應攻擊。

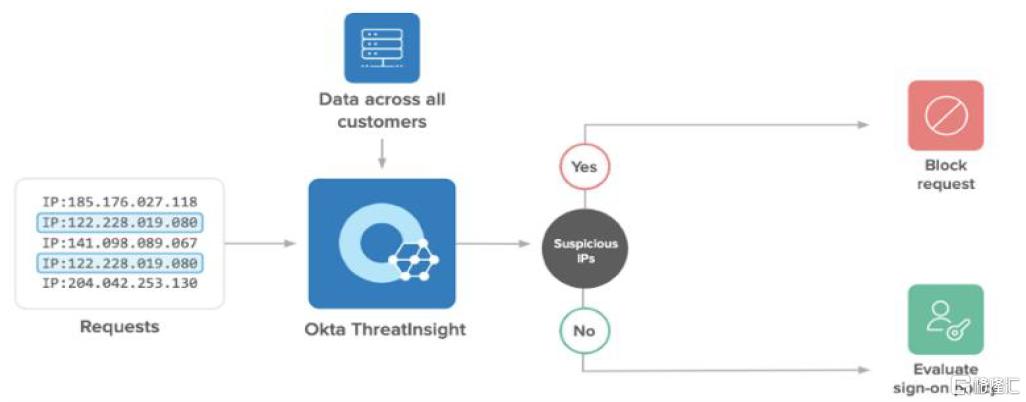

AI技術協助Okta進行威脅檢測,阻止惡意流量。公司為用户推出基準安全功能ThreatInsight,以檢測並緩解各類對Okta數據信息的網絡攻擊。為降低全局路由器級別的DDoS攻擊風險,公司設置了IP黑名單及各類安全控制措施。在已被識別為惡意IP的地址之外,公司仍面臨多個在特定時間內較為可疑的IP地址,ThreatInsight功能可阻止此類可疑IP對受保護的API端點進行訪問。在進行身份驗證前,ThreatInsight藉助啟發式及機器學習技術對在客羣中檢測到的攻擊進行觀察分析,阻止或提升在近期攻擊中識別的基礎設施相關請求,並提供風險評分及應對策略。同時,公司用户可集合ThreatInsight與WAF、DDoS緩解服務等各類網絡安全設備服務,依託不同層級的安全保護,提升數據安全性。

圖表14:Okta ThreatInsight服務示意圖

資料來源:Okta官網,中金公司研究部

Zscaler

AI支撐安全雲框架。公司深耕AI與產品的集成,多個AI、數據科學家團隊持續開展研究,已積累超45項人工智能相關專利。公司具備雲原生、邊緣雲服務架構、大規模SSL檢查、零信任網絡訪問與高效運營等特質,為用户提供更加高效的性能與更強大的安全性。AI賦能安全雲後:1)不同於私有部署產品,雲將AI/ML能力應用於實時流量中,用户在多種場景都可以實現深度分析;2)雲能夠提供AI需要的計算、內存與存儲資源,持續完善AI算法;3)AI能夠分析所有TLS/SSL流量,提升攻擊檢測能力。當前,公司的AI應用成果涵蓋安全、內容分類、數據分類與保護、用户體驗與策略等。

► 應用場景

(1)網絡安全:AI模型能夠發現新型惡意軟件、檢測出網絡釣魚等安全問題,並提供判斷依據,還能實現流量的監控和智能文件隔離。

(2)內容分類:AI提供內容分類能力,能夠識別出DGA,實施訪問控制。

(3)數據保護:利用神經網絡識別具有風險性的用户行為,防範內部威脅和數據泄露問題。

(4)策略提出與體驗提升:基於無監督機器學習、聚類、雙塔神經網絡模型等AI技術,可以自動提出優化業務、降低風險的策略。基於歸納推理、時間序列異常檢測和AI預測模型,可以實現對雲上問題的自動檢測與補救,提升用户體驗。

零信任技術逐漸優化,AI驅動創新增強安全服務邊緣平台。安全服務邊緣(SSE)為專注安全服務的安全訪問服務邊緣(SASE)框架的子集,融合了專用雲平台為用户提供的各類網絡安全服務。SSE包括的核心服務為安全Web網關(SWG)、雲訪問安全代理(CASB)及零信任網絡訪問(ZTNA)框架。公司引入全新的AI技術賦能現有SSE平台,依託安全雲存儲的大量數據進行優化。在高級網絡威脅防護方面,公司藉助實時AI從日常信號中分析識別威脅情報,並阻止網絡釣魚及惡意攻擊;在下一代零信任網絡訪問方面,公司藉助AI技術對不同應用進行攻擊分類,儘可能減少內部攻擊並保護應用程序;在數據體驗監控方面,公司藉助AI分析的原因、各類庫存指標與API集成,提升故障排除效率,保障用户數據安全性。

圖表15:以Zscaler 安全服務邊緣平台SSE為例看AI賦能

資料來源:Zscaler官網,中金公司研究部

總結:基於AI賦能提升檢測能力,內嵌於核心產品打開市場空間

AI賦能安全產品方面,主要雲廠商Google、Amazon、Microsoft在AI領域佈局相對較早,並運用AI技術提升安全能力,保護相關數據及應用;安全廠商擁有豐富的安全數據資產及威脅情報庫,依託數據分析、AI能力強化檢測效率的同時,提升對攻擊的處置和響應能力,並將AI技術沉澱至自身拳頭產品,例如CrowdStrike、Zscaler以AI賦能雲安全;Palo Alto Networks、Fortinet以AI賦能防火牆、網絡層安全;Okta以AI賦能身份驗證產品等。

商業模式層面,目前AI能夠產生收費的模式主要有兩種:

1)作為單一組件提供,單獨收取訂閲費用,例如Palo Alto Networks的NGFW AIOps和Fortinet的FortiNDR;

2)集成至平台產品中,根據提供服務的不同差別定價,例如CrowdStrike的Falcon平台。

各廠商積極探索AI模型保護。微軟在AI保護方面探索相對較多,包括於2020年10月與MITRE合作發佈Adversarial ML Threat Matrix,為安全專家提供檢測、響應、補救ML系統遇到威脅的開放式框架;2021年5月推出開源AI安全風險評估工具Counterfit,該工具起初是專門為目標AI模型編寫的攻擊腳本集,後續演繹為自動化產品,可以對多個系統進行大規模基準測試。

展望國內:AI監管政策落地;安全GPT首發,對標Security Copilot

2023年4月11日,國家網信辦發佈《生成式人工智能服務管理辦法(徵求意見稿)》(下稱意見稿),結合《網絡安全法》、《數據安全法》、《個人信息保護法》等為生成式人工智能服務的發展護航。《意見稿》的關注要點在於產品安全評估審查、生成式內容標識與用户數據保護等。

申報安全評估與持續優化模型訓練共同保障模型安全。根據《意見稿》,人工智能模型產品提供服務前,應當按照規定向國家網信部門申報安全評估,並履行算法備案和變更、註銷備案手續。運行過程中,對於不符合要求的生成內容,除採取內容過濾等措施外,還應在3個月內通過模型優化訓練等方式防止再次生成。此外,生成內容檢測識別成為新難題。為此,《意見稿》要求提供者按照《互聯網信息服務深度合成管理規定》對生成的圖片、視頻等內容進行標識。我們認為,提供服務前的評估申報、運行過程中模型優化要求彰顯了國家對於模型安全的重視,推動了模型保護的發展。

明確用户信息保護責任承擔機制,強調數據安全。《意見稿》指出,生成式人工智能服務提供者涉及個人信息後,應承擔個人信息處理者的法定責任、履行個人信息保護義務。數據收集層面,提供者對預訓練數據及優化訓練數據來源的合法性負責。數據標註階段,制定合規、清晰、具體、可操作的標註規則,培訓標註人員,抽樣核驗標註內容。服務過程中,及時處置個人關於更正、刪除、屏蔽其個人信息的請求,保護用户的輸入信息和使用記錄,包括不得非法留存能夠推斷出用户身份的輸入信息、不得根據用户輸入信息和使用情況進行畫像、不得向他人提供用户輸入信息。我們認為,人工智能的發展對數據安全提出更高要求,數據安全行業景氣度持續提升。

除了對AI模型本身的保護,各廠商也積極將AI技術應用到安全產品,提升產品的檢測效果與運營效率;長期維度,我們認為,AI賦能安全有望助力廠商優化商業模式、降本增效。

風險提示

政策落地不及預期

由於AI監管需要政策推動,相應產品技術落地更有保障。如果政策落地不及預期,則廠商對安全重視程度或降低。

技術發展不及預期

AI與安全相輔相成,AI驅動安全產品降本增效,安全保護AI發展。若AI技術、安全技術發展不及預期,則難以保證AI大模型作為數字基礎設施的安全,同時,AI對於安全的賦能也有限。

下游需求不及預期

大模型發展迅速,技術迭代較快,但下游需求落地仍在探索階段。如果下游需求不及預期,對AI、大模型要求較低,相應地對安全產品需求也會不及預期。

注:本文摘自中金公司2023年5月22日已經發布的《AI安全初探:耦合共生,相輔相成》,分析師:

李虹潔 分析員 SAC 執證編號:S0080522070023 SFC CE Ref:BSZ555

袁佳妮 分析員 SAC 執證編號:S0080523050003 SFC CE Ref:BTM577

錢凱 分析員 SAC 執證編號:S0080513050004 SFC CE Ref:AZA933