You are browsing the Hong Kong website, Regulated by Hong Kong SFC (CE number: BJA907). Investment is risky and you must be cautious when entering the market.

夜讀 | ChatGPT背後

作者:韋青 微軟中國CTO

來源:混沌學園

導讀

他說,“山中方七日,世上幾千年。當你埋頭在屋子里面,研究最新技術進展,比如現在的最火的ChatGPT,出門一看,好像滿世界的人都把它當成了很新鮮的事情。其實ChatGPT3.0算是一個比較大的突破,但它兩年前就有了。它的結構、基本原理也存在很多年了。”

他說,“這輪技術,大概率就是把我們的知識進行提煉……機器是不會想的,想這個詞是人類自己發明出來的。如果你硬把這種能力視爲“想”,不能說錯與對,但它會誤導你對機器的判斷、理解和定義。”

他說,“Sam Altman(OpenAI CEO)那批人就是堅信大模型大力出奇跡,就能夠表徵人類的知識,就這麼簡單。”

ChatGPT的本質是什麼?是否將替代人類工作?我們人類又該如何與之共存?

今天,我們邀請韋青老師,微軟中國CTO做客混沌。他將利用工程師的底層視角,爲大家揭開人工智能的冰山一角,探尋ChatGPT爲何全球爆火。

韋青老師說,“大家有沒有感覺到,每天好像都是見證時代的一天。由於我們的工作背景,在技術領域、在微軟,能看到更多現象,我想跟大家講,首先看到任何現象,先不用感到驚訝。帷幕剛拉開一角,舞臺尚未完全展開。”

01

比真還真的時代

GPT是現在最熱門的話題,但GPT3模型兩年前就培訓出來了。GPT4的出現讓人驚豔,但去年8月份它就已經被訓練出來了。

什麼意思?ChatGPT實際上是冰山一角。當我們看到某些現象出現的時候,某種意義來講,這件事已經結束了。而這個時代纔剛剛開始,ChatGPT現象會層出不窮。

再追逐冰山已經沒什麼意思了,我們要儘快通過浮起的冰山,去理解我們可能進入了一片冰山叢生的海洋。

從一個本質性的構成來講,人類對世界的認知已經經歷了三個階段:農業時代是物質構成的。有地、有糧、有人就等於有權力,有生存的空間;工業時代如果你有能源、有動力,比有糧食還具備競爭力;到第三階段,人類發現信息也是構成世界的一種本源性的存在。思想受什麼影響?信息。

無論是麥克盧漢,還是鮑德里亞的理論,都已經強調了信息、電子信息的出現,可能會使人類社會的結構、邊界、性質、方式都發生變化。

麥克盧漢最出名的理論是地球村。請想象一下,在父母輩的時代,朋友大部分是單位的同事,來自家族、村子、單位。僅僅過了幾十年,現在你的朋友圈還受公司約束嗎?

鮑德里亞的觀點是,如果人類無止境地或者完全氾濫地利用數字化信息技術,我們很快就會進入一個比真還真的時代,那些由人工智能生成的照片、文字,你覺得它是真的嗎?

這幾個月太熱鬧了,或許先不需要這麼快下結論。當你埋頭在屋子里面,研究最新技術進展,比如現在的最火的ChatGPT,出門一看,好像滿世界的人都把它當成了很新鮮的事情。

ChatGPT3.0算是一個比較大的突破,但它兩年前就有了。它的結構、基本原理也存在很多年了。

語言是思想的邊界,這是維特根斯坦說的,但我要給他再加一句話,技術是思想的實現。

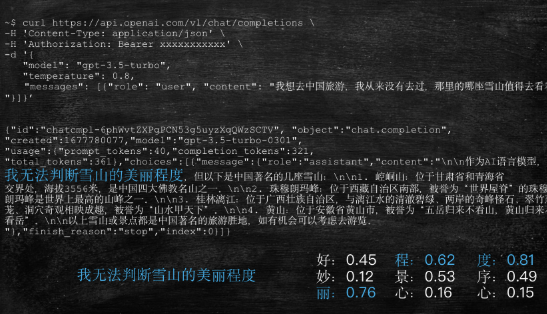

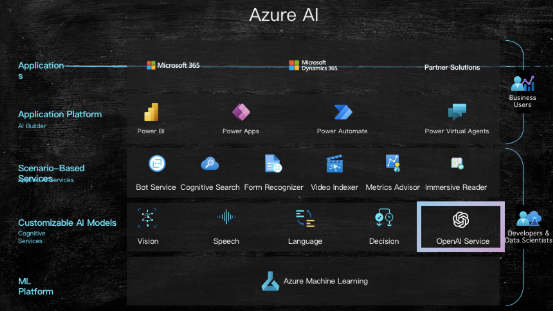

我們忽略了一點,能夠把技術開發出來,先得有一個思想。ChatGPT,實際上它只是一種提取已經被沉澱、被記憶的知識的一種交互方式,底下什麼?是基礎模型。像谷歌的BERT,Facebook的LLaMa。

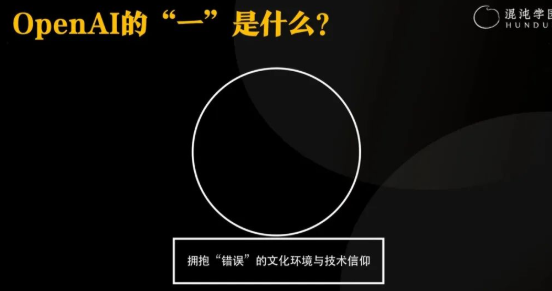

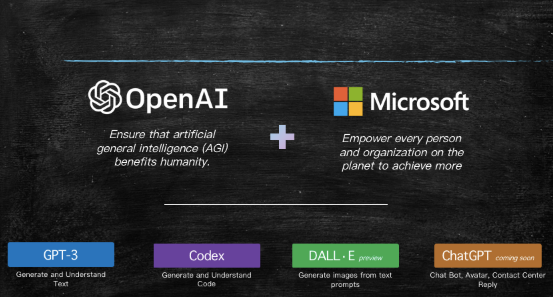

爲什麼GPT現在那麼火?它背後是OpenAI的技術信仰,再加上微軟的Satya(微軟CEO)、Kevin Scott(微軟CTO)這些人的技術信仰的結合。這些人都相信,靠大量的語料和海量的計算,能夠產生出對於知識的沉澱和應用。

Sam Altman說,GPT走出的第一步,是拿把人類知識先沉澱下來。就像先把玫瑰花蒸餾成玫瑰精油。

但精油太濃了,你要使用的話,需要調和。所以第二步,就是用Instruct(指令)的方法,用提示詞的方法,把精煉的玫瑰精油,滴到沐浴露中去。

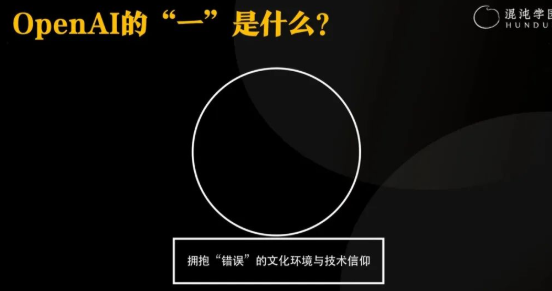

但是,這件事沒被證明可行之前,某種意義上是完全要靠信仰支撐的事情。有多少人敢這麼做?又要花人力、花時間、花海量的金錢,結果可能竹籃打水一場空。某種意義上,它的成功也可以理解成倖存者偏差。

我認爲你要讚歎的,不應該是ChatGPT的模型多麼偉大,而是它背後耐得住寂寞、懷疑的這種定力、決心、信心,這已經是一種技術信仰了。

我們有沒有對於工具、對於數字化技術的技術信仰?這纔是我們應該問自己的。

認知達到信仰的層面,才能夠選一條沒有人走過的路。儘管今天還走不通,但你就認爲這條路可以走,因爲第一性原理告訴你,這樣做是對的,只不過人類的技術還沒有發展到那一步,還證明不出來。

另一個例子是SpaceX。它成功了,大家都覺得太牛了。但當馬斯克後來接受媒體採訪時,他哭了。他說當時我認爲火箭可以回收,但NASA、所有大咖級人物、科學家都跟他講,這條路是走不通的。

OpenAI是一樣的,我們認爲它在2023年1月忽然出名,怎麼可能?它背後有太多的辛酸、堅持、疑惑、搖擺,只不過堅持下來了。 這一輪技術,大概率就是把我們的知識進行提煉。知識哪來的?是我們的所作所爲、所寫所說,落成的文字、視頻、語音,經過數字化之後,被機器去提煉,建成一種模型,變成知識沉澱下來。

爲什麼大家覺得它很神奇呢?因爲沒有任何一個人有這種能力,能記住人類所有的知識。

有些人覺得,機器會涌現出一些思想能力。確實,它會表現成思想能力。但如果你知道它的算法是如何做出來的,你還是會形成自己的判斷。

我要想先聲明一下,每個人都會對這種現象產生不同的解讀。我的解讀是,現在的機器並不具備真正的思想力,是把人類知識記憶之後的一種使用能力。

機器是不會想的,想這個詞是人類自己發明出來的。如果你硬把這種能力視爲“想”,不能說錯與對,但它會誤導你對機器的判斷、理解和定義。

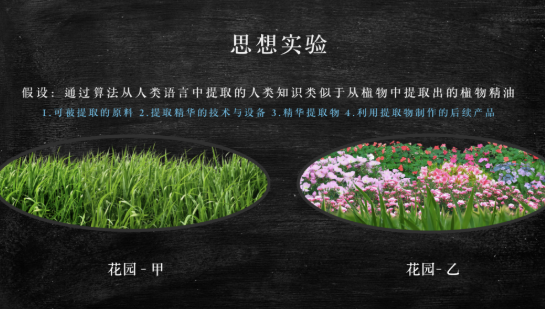

4. 做一個思想實驗,這輪技術到底是什麼?

這一輪技術,大概率就是把我們的知識進行提煉。知識哪來的?是我們的所作所爲、所寫所說,落成的文字、視頻、語音,經過數字化之後,被機器去提煉,建成一種模型,變成知識沉澱下來。

爲什麼大家覺得它很神奇呢?因爲沒有任何一個人有這種能力,能記住人類所有的知識。

有些人覺得,機器會涌現出一些思想能力。確實,它會表現成思想能力。但如果你知道它的算法是如何做出來的,你還是會形成自己的判斷。

我要想先聲明一下,每個人都會對這種現象產生不同的解讀。我的解讀是,現在的機器並不具備真正的思想力,是把人類知識記憶之後的一種使用能力。

機器是不會想的,想這個詞是人類自己發明出來的。如果你硬把這種能力視爲“想”,不能說錯與對,但它會誤導你對機器的判斷、理解和定義。

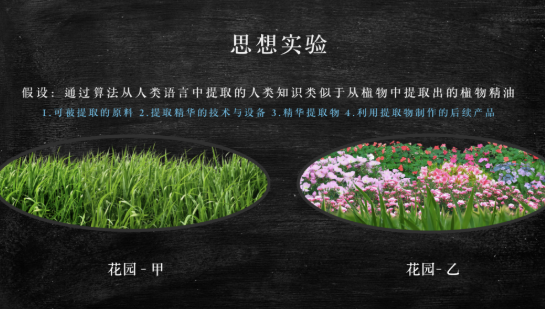

4. 做一個思想實驗,這輪技術到底是什麼? 如果我們發現了,可以通過蒸餾的方式,從植物中蒸餾出它的油性。請問,花園甲跟花園乙的擁有者,做同樣的事情,最後的價值會是怎樣的?他們做出來的東西,對社會的影響力會大不相同。

花園甲的擁有者,會懷疑提純機器不行?還是會痛定思痛,發現原料有問題?

當我們從農業文明進入工業文明,已經受過很多降維打擊了。當物質、能量變成信息的時候,會帶來更加降維式的打擊。

這種競爭方式,已經不是技術能力的競爭,有錢沒錢的競爭……而是文明在一較高低。

你的文明所表現的形式,能否被新一代的會思考的機器學到、吸收到,並且讓它的行爲方式對你有利?

ChatGPT剛火的時候,知乎股價飛漲。在中國,具備語言語料的網站絕對不止知乎。爲什麼它漲得那麼厲害?我沒做過詳細統計,但我認爲,知乎的花園可能類似於花園乙。

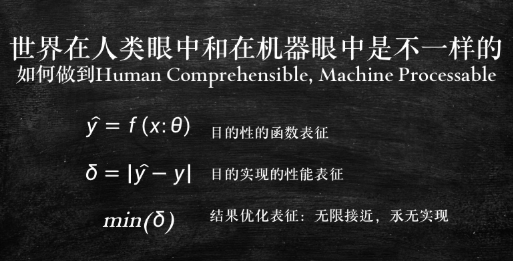

我們再捫心自問下,貴公司、貴機構、貴組織,你們的知識的表現形式、呈現方式,更像是左邊還是右邊?你未來如何跟具備這樣能力的公司競爭?

如果你的信息,無法沉澱成能被機器學習的知識。這一輪的機器能力,你能夠利用到的概率就大爲降低。

如果我們發現了,可以通過蒸餾的方式,從植物中蒸餾出它的油性。請問,花園甲跟花園乙的擁有者,做同樣的事情,最後的價值會是怎樣的?他們做出來的東西,對社會的影響力會大不相同。

花園甲的擁有者,會懷疑提純機器不行?還是會痛定思痛,發現原料有問題?

當我們從農業文明進入工業文明,已經受過很多降維打擊了。當物質、能量變成信息的時候,會帶來更加降維式的打擊。

這種競爭方式,已經不是技術能力的競爭,有錢沒錢的競爭……而是文明在一較高低。

你的文明所表現的形式,能否被新一代的會思考的機器學到、吸收到,並且讓它的行爲方式對你有利?

ChatGPT剛火的時候,知乎股價飛漲。在中國,具備語言語料的網站絕對不止知乎。爲什麼它漲得那麼厲害?我沒做過詳細統計,但我認爲,知乎的花園可能類似於花園乙。

我們再捫心自問下,貴公司、貴機構、貴組織,你們的知識的表現形式、呈現方式,更像是左邊還是右邊?你未來如何跟具備這樣能力的公司競爭?

如果你的信息,無法沉澱成能被機器學習的知識。這一輪的機器能力,你能夠利用到的概率就大爲降低。

02

機器文明,冰山一角

時代的鉅變有個好處,不管你多麼先進,多麼落後,在這個時代又拉平了。

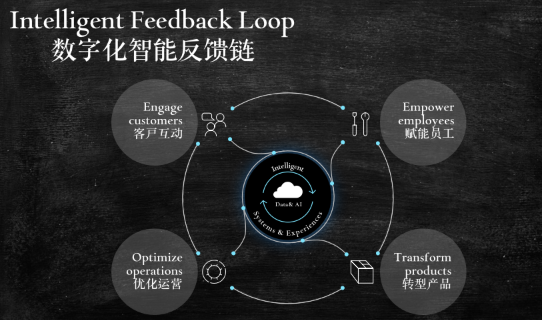

微軟CEO Satya說的刷新,Hit Refresh就是此意,重來過一遍。在這一輪的技術潮流下,我們如何重新獲得定位?需要我們每一個人思考。

1. 衝着ChatGPT創新,等於拎包入住而沒有自己的地基

古人有一句話叫“聖人畏因,凡人畏果。” 有了理念、信仰、追求,才能產生結果,如果我們只抓着結果,很容易只見樹木、不見森林。

拿ChatGPT來舉例子。當我們看到這個技術結果的時候,要相信它不是從石頭里蹦出來的。

2023年1月,微軟CEO Satya和Sam Altman(OpenAI CEO)的合照在網上很火,他們跟大家介紹了雙方的合作和技術的進步。但其實在2016年,雙方已經開始探討了。 OpenAI的成長,也是在不斷摸索的。大家可以看一本書,《深度學習革命》,以OpenAI這批人爲代表的深度學習實踐者和探索者們,怎樣從當初對谷歌人工智能產生一些擔憂,到成立這間公司。一切都是有脈絡可循的,是幾十年的摸索、試錯,才走到今天這一步的。

如果我們衝着GPT的模型去了,從創新的角度來講,我把它稱之爲拎包入住。

大家想象一下,一片未開墾的土地,長滿雜草茂木。但有人把它開墾出來了,又根據土地的特點,設計出人類能夠居住的房屋,把樓給造起來了,再找一些設計師精裝修。最後招商引資。

這時我們都看到了趨勢,發現只要找個50層以上的公寓房做生意就能夠大賺特賺,就拎包入住了。當時確實大賺特賺了。但若幹年之後,文明變了,潮流變了,50層以上的房屋不受歡迎了,你怎麼辦?

OpenAI有很多算法,很多工具,它曾經在機器人上投資,現在有人去看它的機器人嗎?ChatGPT只是它在衆多的嘗試中,湊巧發現了一條路可以往前走。你要跟着它這條路走,有點像守株待兔,認爲兔子永遠會撞在這棵樹上。

我認爲,其實各位可以在這一輪,去看OpenAI的理念,最早這些人是怎麼想的、怎麼做的、願景是什麼。

拿ChatGPT舉例,它下層有兩類支柱,產物、產出它的人。別隻關注ChatGPT或GPT4,去看更深層的東西。

一方面是大語言模型,賴以沉澱人類所有的知識,或者是能夠被它學習到的所有知識的機制。是Transformer/RNN/CNN/LSTM,是用數學的方式,表徵物理世界和人類知識與行爲的特徵。

另一方面,OpenAI,也是由人構成。公司就是由一批志同道合者構成的一個組織,去完成一個共同的願景,共同的一個目標。

這些人才是一批有科學修養的,又有工程實現能力的,又對語言學、計算機科學的第一性原理有深刻理解的。更關鍵的是,有一個共同的理想,堅信做這件事是對的,是有用的。

其實有很多人正因爲OpenAI所謂的成功,反而離開了,因爲覺得願景不一樣了。這是它的人才特徵。

人才特徵的背後又是什麼?容錯、合作、開放的文化,不拘一格降人才的用人風格,配合的風格,彼此交流的風格。

如果我們連辦公場所都嚴格要求,老闆、員工分級坐,等級森嚴,是很漠然的羣體,有可能做成這件事嗎?

我自己也是管理者,感觸還蠻深的。各個企業的文化真的不一樣。有開放的、有封閉的、有嚴厲的、有寬鬆的、有說一套做一套的,有說知行合一的,所處的行業特徵,社會的氛圍也真的是不一樣的。

錯誤是成功的前提條件。你公司的環境,整個的社會大環境,允許不允許這種容錯文化的出現?

OpenAI的成長,也是在不斷摸索的。大家可以看一本書,《深度學習革命》,以OpenAI這批人爲代表的深度學習實踐者和探索者們,怎樣從當初對谷歌人工智能產生一些擔憂,到成立這間公司。一切都是有脈絡可循的,是幾十年的摸索、試錯,才走到今天這一步的。

如果我們衝着GPT的模型去了,從創新的角度來講,我把它稱之爲拎包入住。

大家想象一下,一片未開墾的土地,長滿雜草茂木。但有人把它開墾出來了,又根據土地的特點,設計出人類能夠居住的房屋,把樓給造起來了,再找一些設計師精裝修。最後招商引資。

這時我們都看到了趨勢,發現只要找個50層以上的公寓房做生意就能夠大賺特賺,就拎包入住了。當時確實大賺特賺了。但若幹年之後,文明變了,潮流變了,50層以上的房屋不受歡迎了,你怎麼辦?

OpenAI有很多算法,很多工具,它曾經在機器人上投資,現在有人去看它的機器人嗎?ChatGPT只是它在衆多的嘗試中,湊巧發現了一條路可以往前走。你要跟着它這條路走,有點像守株待兔,認爲兔子永遠會撞在這棵樹上。

我認爲,其實各位可以在這一輪,去看OpenAI的理念,最早這些人是怎麼想的、怎麼做的、願景是什麼。

拿ChatGPT舉例,它下層有兩類支柱,產物、產出它的人。別隻關注ChatGPT或GPT4,去看更深層的東西。

一方面是大語言模型,賴以沉澱人類所有的知識,或者是能夠被它學習到的所有知識的機制。是Transformer/RNN/CNN/LSTM,是用數學的方式,表徵物理世界和人類知識與行爲的特徵。

另一方面,OpenAI,也是由人構成。公司就是由一批志同道合者構成的一個組織,去完成一個共同的願景,共同的一個目標。

這些人才是一批有科學修養的,又有工程實現能力的,又對語言學、計算機科學的第一性原理有深刻理解的。更關鍵的是,有一個共同的理想,堅信做這件事是對的,是有用的。

其實有很多人正因爲OpenAI所謂的成功,反而離開了,因爲覺得願景不一樣了。這是它的人才特徵。

人才特徵的背後又是什麼?容錯、合作、開放的文化,不拘一格降人才的用人風格,配合的風格,彼此交流的風格。

如果我們連辦公場所都嚴格要求,老闆、員工分級坐,等級森嚴,是很漠然的羣體,有可能做成這件事嗎?

我自己也是管理者,感觸還蠻深的。各個企業的文化真的不一樣。有開放的、有封閉的、有嚴厲的、有寬鬆的、有說一套做一套的,有說知行合一的,所處的行業特徵,社會的氛圍也真的是不一樣的。

錯誤是成功的前提條件。你公司的環境,整個的社會大環境,允許不允許這種容錯文化的出現? 我說如果你要做一個ChatGPT,個人的建議,還是別玩這個遊戲了。就像是打冰球,追着冰球打太難了,你最好天天求什麼?求前面沒人打了。但那時,新的賽道又開出來了。天天在說彎道超車,等你真超過去才發現,前面已經沒車了。

新開闢一條道路,需要建立這種環境,建立這種文化,培養這種人才,這纔是最基本的。Sam Altman那批人就是堅信大模型大力出奇跡,就能夠表徵人類的知識,就這麼簡單。

通用人工智能(AGI)是他們的追求。OpenAI會爲之付出無窮的努力,不懈的追求,直到證明它絕對不行了。只不過,很巧它成了。但就算在AGI上,大家的關注點,也都各有側重。

20年前谷歌剛成立的時候,只是個搜索引擎。你會感到很無釐頭,一個搜索引擎,爲什麼把不作惡作爲標準?現在大家明白了吧,在一個“比真還真的時代”,給你的信息當然可以作惡。

AI也一樣。微軟明確指出要做負責任的AI,谷歌說的叫不作惡。OpenAI提出UBI,全民基本收入(UBI,是指“無條件”地爲所有個人定期發放一筆現金收入)。

Sam Altman在採訪中說,需要新思想回答的三個問題是:如何分配通用人工智能產生的利潤?如何分享通用人工智能的訪問權?如何分擔通用人工智能的治理權?

大家想一想,爲什麼Sam Altman想到了這三個問題?

還是因爲AGI一旦推出來,大家馬上就會發現,它的能力太大了,如果不能讓人類在這三個問題上達成共識,有人賺便宜、有人吃虧,就產生動盪的因素了。AGI帶來的這些議題,需要我們去了解。

建議大家看一下《大都會》這部電影。它1927年上映,到現在馬上100年了,你會發現,我們幾乎在重演歷史。

我說如果你要做一個ChatGPT,個人的建議,還是別玩這個遊戲了。就像是打冰球,追着冰球打太難了,你最好天天求什麼?求前面沒人打了。但那時,新的賽道又開出來了。天天在說彎道超車,等你真超過去才發現,前面已經沒車了。

新開闢一條道路,需要建立這種環境,建立這種文化,培養這種人才,這纔是最基本的。Sam Altman那批人就是堅信大模型大力出奇跡,就能夠表徵人類的知識,就這麼簡單。

通用人工智能(AGI)是他們的追求。OpenAI會爲之付出無窮的努力,不懈的追求,直到證明它絕對不行了。只不過,很巧它成了。但就算在AGI上,大家的關注點,也都各有側重。

20年前谷歌剛成立的時候,只是個搜索引擎。你會感到很無釐頭,一個搜索引擎,爲什麼把不作惡作爲標準?現在大家明白了吧,在一個“比真還真的時代”,給你的信息當然可以作惡。

AI也一樣。微軟明確指出要做負責任的AI,谷歌說的叫不作惡。OpenAI提出UBI,全民基本收入(UBI,是指“無條件”地爲所有個人定期發放一筆現金收入)。

Sam Altman在採訪中說,需要新思想回答的三個問題是:如何分配通用人工智能產生的利潤?如何分享通用人工智能的訪問權?如何分擔通用人工智能的治理權?

大家想一想,爲什麼Sam Altman想到了這三個問題?

還是因爲AGI一旦推出來,大家馬上就會發現,它的能力太大了,如果不能讓人類在這三個問題上達成共識,有人賺便宜、有人吃虧,就產生動盪的因素了。AGI帶來的這些議題,需要我們去了解。

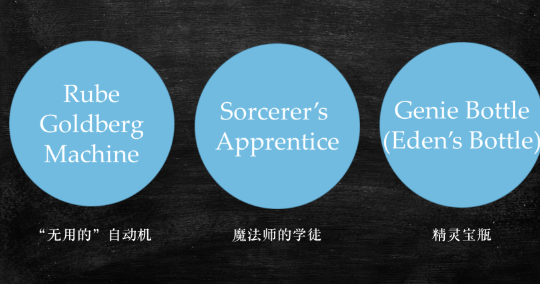

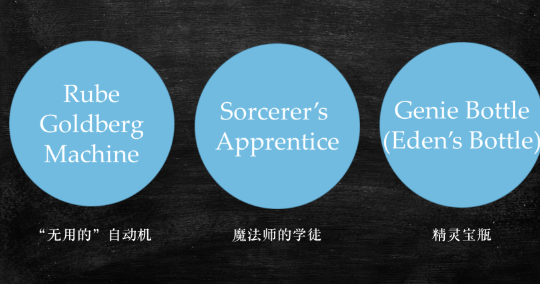

建議大家看一下《大都會》這部電影。它1927年上映,到現在馬上100年了,你會發現,我們幾乎在重演歷史。 1)無用的機器。出現了過度設計的無用的自動機。仔細想一想,它每一個理念,每一個精巧的激發過程和動作,是不是我們現在人工智能、機器人的思想的底蘊?

那麼,我們有沒有可能在不接受,甚至排斥“無用的自動機”前提下,鼓勵工程師,孩子們去創造出這種自動機的文明?當不被鼓勵、允許時候,他們有沒有可能去做自動化的事兒?

我再舉個例子,我們這個文明是不接受多米諾骨牌有任何價值的。但實際上,多米諾骨牌跟無用的自動機,背後都有一個隱含的、對於自動機的一種強烈的發自內心的追求。人工智能沒成功前的所有投入,都是無用的自動機。這就是我們要深思的。

2)魔法師的學徒。名字來源於歌德的戲劇,它在全球技術領域經常被引用,說人類在開創一些魔法式的技術,但魔法需要被制衡,開啓魔法以外,要會關。

3)精靈寶瓶。你不但要關掉魔法,還得把它收回去。留在世上可能也會有問題。

《大都會》結尾有一句經典名言,說在負責思考、籌劃的大腦跟執行任務的雙手之間,必須有一個調節者,這個調節者必須是人心。

我想說,當你爲ChatGPT激動不已,腦補着很多東西的時候,有些議題其實已經被思考100多年了。而且,還沒有定論。一兩百年過去了,大家仍然在探討自動機的普遍流行造成的後果,和相應的人文上的制約。

這就是蓋子揭開之後,人類所面臨的話題。這是遠比所謂的人工智能奇異點,更宏大、更深刻、更嚴峻的話題。

1)無用的機器。出現了過度設計的無用的自動機。仔細想一想,它每一個理念,每一個精巧的激發過程和動作,是不是我們現在人工智能、機器人的思想的底蘊?

那麼,我們有沒有可能在不接受,甚至排斥“無用的自動機”前提下,鼓勵工程師,孩子們去創造出這種自動機的文明?當不被鼓勵、允許時候,他們有沒有可能去做自動化的事兒?

我再舉個例子,我們這個文明是不接受多米諾骨牌有任何價值的。但實際上,多米諾骨牌跟無用的自動機,背後都有一個隱含的、對於自動機的一種強烈的發自內心的追求。人工智能沒成功前的所有投入,都是無用的自動機。這就是我們要深思的。

2)魔法師的學徒。名字來源於歌德的戲劇,它在全球技術領域經常被引用,說人類在開創一些魔法式的技術,但魔法需要被制衡,開啓魔法以外,要會關。

3)精靈寶瓶。你不但要關掉魔法,還得把它收回去。留在世上可能也會有問題。

《大都會》結尾有一句經典名言,說在負責思考、籌劃的大腦跟執行任務的雙手之間,必須有一個調節者,這個調節者必須是人心。

我想說,當你爲ChatGPT激動不已,腦補着很多東西的時候,有些議題其實已經被思考100多年了。而且,還沒有定論。一兩百年過去了,大家仍然在探討自動機的普遍流行造成的後果,和相應的人文上的制約。

這就是蓋子揭開之後,人類所面臨的話題。這是遠比所謂的人工智能奇異點,更宏大、更深刻、更嚴峻的話題。

03

如何利用機器?

“教-學”相長,“有-用”相隨

人和機器的關係是什麼?比較理想的狀況,是由機器彌補人類的弱點。那麼,首先機器的優點、弱點是什麼?人類的優點、弱點是什麼?我們知道嗎?

第二,人類怎麼指揮機器?機器怎麼能夠被指揮?怎麼能夠不被指揮?我們考慮過嗎?

第三,教學相長。我們要明白它是怎麼學的,才能明白怎麼去教它。

1. “教-學”相長

這點我特別希望想跟大家強調一下。否則,我們會誤以爲機器真能憑空學到知識。

Follow us

Find us on

Facebook,

Twitter ,

Instagram, and

YouTube or frequent updates on all things investing.Have a financial topic you would like to discuss? Head over to the

uSMART Community to share your thoughts and insights about the market! Click the picture below to download and explore uSMART app!

Disclaimers

uSmart Securities Limited (“uSmart”) is based on its internal research and public third party information in preparation of this article. Although uSmart uses its best endeavours to ensure the content of this article is accurate, uSmart does not guarantee the accuracy, timeliness or completeness of the information of this article and is not responsible for any views/opinions/comments in this article. Opinions, forecasts and estimations reflect uSmart’s assessment as of the date of this article and are subject to change. uSmart has no obligation to notify you or anyone of any such changes. You must make independent analysis and judgment on any matters involved in this article. uSmart and any directors, officers, employees or agents of uSmart will not be liable for any loss or damage suffered by any person in reliance on any representation or omission in the content of this article. The content of the article is for reference only and does not constitute any offer, solicitation, recommendation, opinion or guarantee of any securities, virtual assets, financial products or instruments. Regulatory authorities may restrict the trading of virtual asset-related ETFs to only investors who meet specified requirements. Any calculations or images in the article are for illustrative purposes only.

Investment involves risks and the value and income from securities may rise or fall. Past performance is not indicative of future performance. Please carefully consider your personal risk tolerance, and consult independent professional advice if necessary.